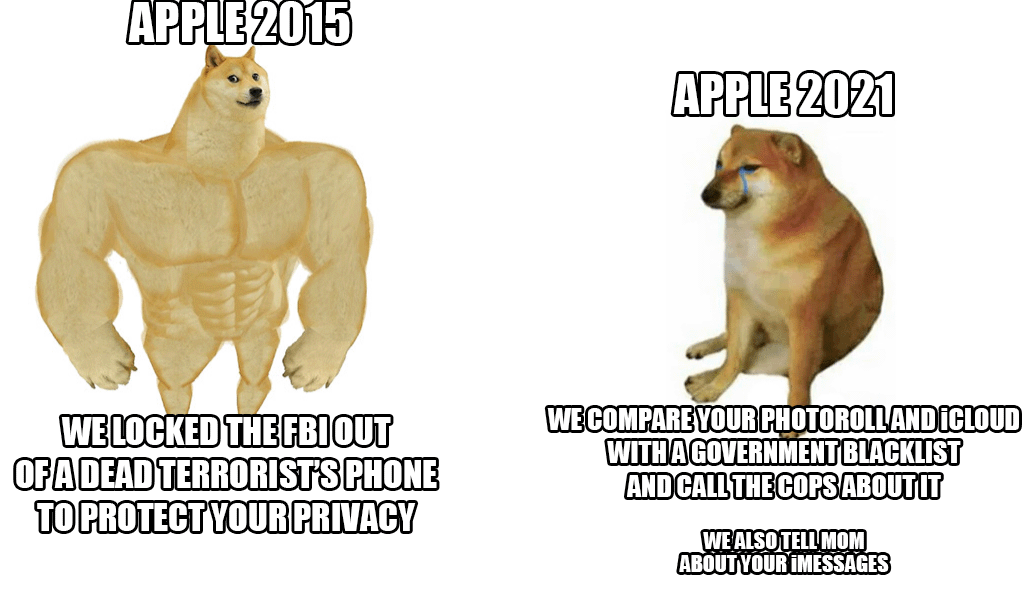

上週末,我們向您介紹了一個相當有趣的新奇事物,這是一個用於檢測描繪虐待兒童的圖像的新系統。具體來說,蘋果將掃描 iCloud 上儲存的所有照片,一旦發現,將向相關當局報告這些情況。儘管該系統在設備內「安全」運行,但該巨頭仍然因侵犯隱私而受到批評,受歡迎的舉報人愛德華·斯諾登也宣布了這一點。

它可能是 你有興趣

問題在於,蘋果到目前為止一直依賴用戶的隱私,它希望在任何情況下都保護用戶的隱私。但這個消息直接顛覆了他們原本的態度。蘋果種植者實際上面臨既成事實,必須在兩種選擇之間做出選擇。他們要么讓一個特殊的系統掃描 iCloud 上儲存的所有圖片,要么他們將停止使用 iCloud 照片。然後整件事情就會變得非常簡單。 iPhone 將下載哈希資料庫,然後將其與照片進行比較。同時,也會介入新聞,保護孩子,及時告知家長危險行為。人們的擔憂源於這樣一個事實:有人可能濫用資料庫本身,甚至更糟的是,系統不僅可能掃描照片,還可能掃描訊息和所有活動。

當然,蘋果必須盡快回應批評。為此,例如,它發布了一份常見問題解答文檔,現在確認該系統只會掃描照片,而不會掃描影片。他們還將其描述為比其他科技巨頭正在使用的版本更加保護隱私的版本。同時,蘋果公司更準確地描述了整個事情的實際運作方式。如果將資料庫與 iCloud 上的映像進行比較時出現匹配,則會為此建立加密安全憑證。

正如上面已經提到的,該系統也將相對容易被繞過,這一點得到了蘋果的直接證實。在這種情況下,只需停用 iCloud 上的「照片」即可輕鬆繞過驗證過程。但有一個問題出現了。這值得麼?無論如何,好消息仍然是該系統僅在美國實施,至少目前是如此。您如何看待這個制度?您是否贊成將其引入歐盟國家,或者這是否過於侵犯隱私?

嗯,這很複雜。隱私保護當然幾乎高於一切。這也是我使用這個平台的原因之一。但凡事都有其限度。簡而言之,每項自由都以侵犯他人自由而告終。顯然,必須對那些願意傷害或虐待兒童的人採取行動。這是毫無爭議的。

正如上面已經提到的,該系統也將相對容易被繞過,蘋果直接證實了這一點。在這種情況下,只需停用 iCloud 上的「照片」即可輕鬆繞過驗證過程。

因為同時表示關閉共享相簿。多麼簡單啊親愛的華生:)

未經指定機構授權自動翻閱照片原則上是錯誤的,我敢打賭這只是第一步。有很多事情可以做,一開始是正當的,然後就無法再阻止了:兒童色情->白肉貿易->虐待動物->不注意駕駛->參與反對派活動派對...

問題在於是什麼使這個過程成為可能。為什麼手機和作業系統製造商必須告訴我們作為用戶包含哪些內容?當然,特別是對合適的孩子來說,聽得非常好,因此蘋果甚至贊助了一款最先進的設備來處理這個問題。為什麼非營利組織要解決這個問題,因為孩子對國家不感興趣?如果我沒有做錯任何事,我並不介意,但他們讓每個 iPhone/iPad 用戶都成為潛在的犯罪者。這是扭曲的邏輯,我想說最簡單的解決方案之一,我們將安全地掃描您的照片。因此,每個透過iMessage 向我發送兒童色情內容的人都會感到沮喪,因為我是一個罪犯,我將因我不感興趣的事情而向一家私人公司負責,同時我不會登錄,因為ID 將被屏蔽。所有那些愚蠢到分享孩子的照片並將其備份到雲端的沮喪的人都會去其他地方,因為最愚蠢的人會因此而陷入困境。還有一對父母不小心用pindik/pipinka 給他們的孩子拍了一張照片。打的好。

為什麼他們會抓那些給他們的孩子拍裸照的父母呢?那樣不行

是的,我寫錯了,所以它可能不起作用。並進一步 ?